ChatGPT的爆火,生动诠释了什么是“人红是非多”,发展至今已经吸引了众多互联网大佬的关注和讨论。

毋庸置疑,对于一款具有分水岭意义的产品而言,不少企业家都认同大型语言模型的广泛应用。微软创始人比尔盖茨曾表示:“ChatGPT的诞生丝毫不亚于个人电脑的诞生。”英伟达创始人黄仁勋也表示:“ChatGPT只是起点,我们正处于AI的iPhone时刻。”谷歌前AI团队成员、deeplearning.ai创始人吴恩达曾在推特上发表言论,认为ChatGPT等大型语言模型是“人工智能领域最为激动人心的进展之一。”

但也有部分企业家认为,ChatGPT们的火爆背后,隐忧犹存。

人工智能需要强监管吗?

我们在人工智能的发展方面,是否步伐太快?

3月末,生命未来研究所(Future of Life)发布了一封公开信,包括马斯克在内的上千名人工智能研究人员和技术高管进行了签名,呼吁所有人工智能实验室暂停比GPT-4更强大的人工智能系统的训练,暂停时间至少为6个月。

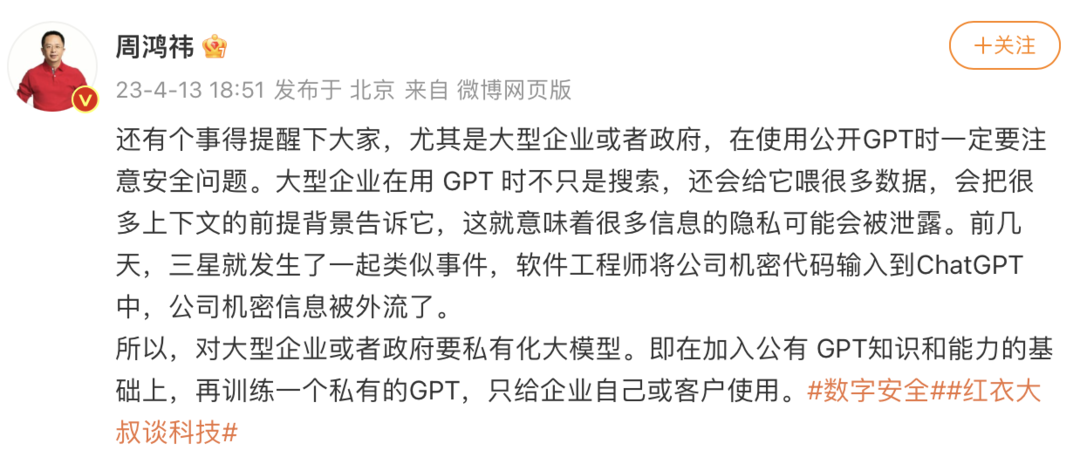

对此,国内的相关企业家也对此示警:刘慈欣曾在一次采访中表示:“ChatGPT等大型语言模型的出现将彻底改变人类的阅读和写作方式,同时也会带来一些新的道德和伦理问题。”周鸿祎也曾就相关大型语言模型的安全性问题给予提醒:“在使用公开GPT时一定要注意安全问题。大型企业在用 GPT 时不只是搜索,还会给它喂很多数据,会把很多上下文的前提背景告诉它,这就意味着很多信息的隐私可能会被泄露。”

毋庸置疑,ChatGPT这样的产品是人工智能产业发展的里程碑。但即使是火爆如ChatGPT,也面临着至暗时刻的来临。

不久前,以色列网络安全公司Team8的最新报告显示,使用ChatGPT等生成式人工智能的企业可能会因此泄露客户信息和商业机密。该报告称,新型人工智能聊天机器人和协作工具的广泛普及,可能会令一些公司面临数据泄露和法律风险。他们担心黑客可能会利用聊天机器人获取敏感的企业信息或对企业发动攻击。此外,目前投喂给聊天机器人的机密信息未来也有可能会被人工智能公司利用。

除此之外,各国政府对于ChatGPT的态度也开始变得更加冷静。

美国联邦贸易委员会(FTC)也表示将重点关注滥用人工智能技术违反反歧视法或存在欺骗行为的公司。意大利个人数据保护局宣布,从即日起禁止使用聊天机器人ChatGPT,并限制开发这一平台的OpenAI公司处理意大利用户信息。英国则发布了一份文件,建议监管机构监督人工智能的发展,重点在安全性、透明度和公平性。

AI的使用离不开适度监管

阿里通义千问、飞书My AI、知乎知海图 AI、京东言犀、马斯克的 TruthGPT 都冒出了头,科技互联网行业一时之间,好不热闹。当越来越多的企业跑步入场,大型语言模型也面临着越来越多的困局。

4月18日,CSDN发布《2022-2023 中国AIoT开发者调查报告》。报告中提到:“对AIoT抱持不安全感态度的开发者占比6%,也有11%的开发者担心AIoT会加剧失业问题。”并且,伴随AIoT技术的广泛应用,也会带来一系列伦理、法律和社会影响,将改变我们经济发展路径和社会生活形态。因此,在AIoT技术普及之前,需要开展广泛的社会、文化和伦理的探讨研究。

目前,ChatGPT作为生成式AI的代表已经迭代到了ChatGPT 4.0。随着版本的更新迭代,GPT-4的文字输入限制也得到了提升,达到了2.5万字,并且对于非英语语种的支持也得到了更多的优化。这也使得ChatGPT不仅能够更加准确地回答问题,还具备更高水平的图像识别能力。此外,ChatGPT 4.0还能够生成歌词和创意文本,并且实现了风格的多样性。

相关资料显示,初代GPT模型的参数是1.17亿个,GPT-2是15亿个,GPT-3模型参数量达到1750亿,是GPT-2的100倍;而GPT-4的真实参数在1750亿-2800亿之间,重点在数据处理优化上。

但需要注意的是,伴随着ChatGPT成长而越来越庞大的数据和越来越强的算力,也意味着更大的数据和隐私风险。据报道,三星在引入ChatGPT不到20天里,就已经发生了三起半导体机密资料外泄事故,涉及测量资料、产品良品率等内容,传闻已被存入到ChatGPT学习资料库中。大型语言模型的负面效应已经开始展现。

在国内,相关政策的制定已经走在前列。此前,《生成式人工智能服务管理办法(征求意见稿)》面向社会征求意见,这意味着,当下备受关注的生成式AI产业将迎来首份监管文件。从生成式人工智能服务商的准入,到算法设计、训练数据选择、模型、内容,以及用户个人隐私、商业秘密等方面提出了相关要求。其中特别强调了生成式人工智能产品训练数据及生成内容的真实性、合法性,要求提供者应当对生成式人工智能产品的预训练数据、优化训练数据来源的合法性负责。

或许,这将是人工智能产业发展的必由之路:在为人工智能发展制定框架的同时留足发展空间,让人工智能得以实现大范围普及。毕竟,技术本身没有好坏之分,但“技术不作恶”,才是产业发展的根本底线。

评论 2

fmba78db 2023-04-20 发表于四川

技术无善恶 重要的是背后的算法操控者

锦书 2023-04-20 发表于四川

人工智能的“潘多拉魔盒”